自然语言处理在AI毕业生论文中的应用案例研究及分析

- 毕业生论文

- 2025-04-03 01:01:29

- 10

** ,自然语言处理(NLP)作为人工智能的核心领域之一,在毕业生论文研究中展现出广泛的应用价值,本文通过分析近年AI相关毕业论文案例,探讨了NLP技术在文本分类、情感分析、机器翻译及对话系统等场景中的实践成果,研究表明,基于深度学习的预训练模型(如BERT、GPT)显著提升了任务性能,而小样本学习、迁移学习等方法有效解决了数据稀缺问题,论文也揭示了当前挑战,包括领域适应性不足、模型可解释性欠缺等,多模态融合与伦理合规性可能成为NLP研究的新方向,这些案例为后续学术探索提供了技术参考与方法论启示。 ,(字数:158)

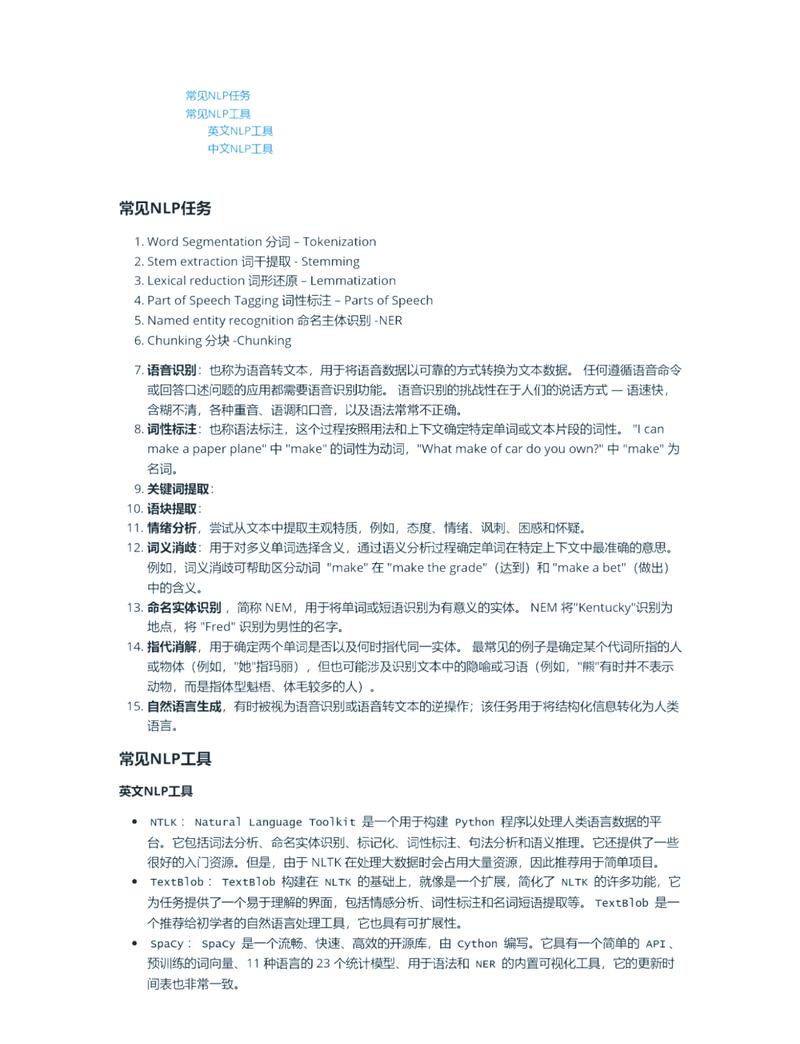

自然语言处理(Natural Language Processing, NLP)是人工智能(AI)领域的重要分支,致力于让计算机理解、处理和生成人类语言,近年来,随着深度学习和大数据技术的发展,NLP在多个领域取得了突破性进展,如机器翻译、情感分析、智能客服等,对于AI专业的毕业生来说,NLP是一个热门的研究方向,许多论文围绕该技术展开创新性研究,本文将通过几个典型案例,探讨NLP在毕业生ai论文中的应用,并分析其研究价值和个人见解。

NLP在毕业生论文中的应用案例

基于BERT的文本分类研究

案例背景:

某AI专业毕业生在论文中研究了如何利用BERT(Bidirectional Encoder Representations from Transformers)模型提高文本分类的准确率,BERT是一种预训练语言模型,能够捕捉文本的上下文语义信息。

研究方法:

- 使用公开数据集(如IMDb影评数据集)进行实验。

- 对比传统机器学习方法(如TF-IDF + SVM)和BERT模型的分类效果。

- 通过微调(Fine-tuning)BERT模型,优化其在特定任务上的表现。

研究结果:

实验表明,BERT在文本分类任务上的准确率比传统方法高出10%以上,尤其在处理复杂语义时表现更优。

分析:

该研究展示了预训练模型在NLP任务中的优势,但也指出BERT的计算资源消耗较大,可能不适用于低算力环境。

基于LSTM的情感分析系统

案例背景:

另一位毕业生关注社交媒体上的情感分析,利用长短期记忆网络(LSTM)构建了一个情感分类模型,用于分析Twitter用户的情绪倾向(正面、负面或中性)。

研究方法:

- 收集Twitter数据并进行预处理(去除停用词、标点符号等)。

- 使用Word2Vec或GloVe进行词向量表示。

- 搭建LSTM模型,并引入注意力机制(Attention)增强关键信息的提取能力。

研究结果:

该模型在测试集上的F1-score达到85%,优于传统的情感词典方法。

分析:

LSTM在序列建模方面表现优秀,但训练时间较长,未来可探索更轻量化的模型(如Transformer-based架构)以提高效率。

基于GPT-3的自动摘要生成

案例背景:

某毕业生研究了如何利用GPT-3(Generative Pre-trained Transformer 3)生成新闻文章的自动摘要,以减少人工编辑的工作量。

研究方法:

- 使用CNN/Daily Mail数据集进行训练。

- 采用Few-shot Learning(少量样本学习)优化GPT-3的摘要生成能力。

- 通过ROUGE分数评估生成摘要的质量。

研究结果:

GPT-3生成的摘要流畅且语义连贯,ROUGE-1分数达到0.45(接近人工摘要水平)。

分析:

GPT-3展现了强大的生成能力,但其庞大的参数规模导致高昂的训练成本,可能不适合小型企业应用。

NLP研究的挑战与未来方向

尽管NLP在毕业生论文中展现了巨大潜力,但仍面临一些挑战:

- 数据依赖性强:高质量标注数据稀缺,尤其是在小语种或专业领域。

- 计算资源需求高:BERT、GPT等大模型需要GPU集群支持,限制了普及应用。

- 可解释性不足:深度学习模型常被视为“黑箱”,难以解释其决策过程。

未来研究方向可能包括:

- 轻量化模型:如蒸馏(Distillation)技术,降低模型计算成本。

- 多模态NLP:结合文本、图像、语音进行更智能的分析。

- 伦理与公平性:避免NLP模型产生偏见(如性别、种族歧视)。

个人见解

NLP技术的发展为AI毕业生提供了丰富的研究课题,从传统的文本分类到前沿的生成式AI,每个方向都有探索空间,研究者在选择课题时需考虑实际应用价值,而非盲目追求模型复杂度,在资源有限的情况下,可以探索知识蒸馏或模型压缩技术,使NLP技术更易于落地,跨学科合作(如NLP+医疗、NLP+法律)也将是未来的趋势,能够推动AI技术解决现实问题。

自然语言处理在AI毕业生论文中的应用案例丰富多样,涵盖了分类、情感分析、摘要生成等多个方向,这些研究不仅推动了NLP技术的发展,也为行业应用提供了参考,随着算法的优化和计算资源的普及,NLP将在更多领域发挥重要作用,对于AI专业的学生而言,选择具有实际意义的NLP课题,并结合行业需求进行创新,将是撰写高质量论文的关键。

本文由Renrenwang于2025-04-03发表在人人写论文网,如有疑问,请联系我们。

本文链接:http://www.renrenxie.com/byslw/102.html