联邦学习,应用场景与挑战分析

- 毕业生论文

- 2025-04-03 00:27:12

- 9

联邦学习是一种分布式机器学习范式,允许多个参与方在数据不离开本地的前提下协作训练模型,广泛应用于医疗、金融、智能终端等领域,在医疗场景中,医院可联合训练疾病诊断模型而不共享患者隐私数据;金融领域通过跨机构风控建模提升反欺诈能力;智能手机则利用用户本地数据优化输入法推荐,该技术面临三大核心挑战:一是数据异构性导致模型性能波动,需设计鲁棒算法;二是通信效率瓶颈,需平衡收敛速度与带宽成本;三是隐私与安全的双重考验,既要防范恶意参与方的梯度泄露攻击,又需满足GDPR等合规要求,联邦学习的发展依赖于加密技术、激励机制与标准化框架的协同突破。

近年来,随着人工智能(AI)技术的快速发展,数据隐私和安全问题日益受到关注,传统的机器学习方法通常需要将数据集中存储和处理,这在医疗、金融等敏感领域可能引发隐私泄露风险,为了解决这一问题,联邦学习(Federated Learning, FL)应运而生。

联邦学习是一种分布式机器学习框架,允许多个设备或机构在不共享原始数据的情况下协同训练模型,本文将从联邦学习的核心概念出发,探讨其典型应用场景,并分析当前面临的主要挑战,帮助读者更好地理解这一前沿技术。

什么是联邦学习?

联邦学习最早由谷歌在2016年提出,其核心思想是“数据不动,模型动”,在传统机器学习中,数据需要上传到中央服务器进行训练,而联邦学习则采用去中心化的方式:

- 本地训练:每个参与方(如手机、医院、银行等)在本地数据上训练模型。

- 模型聚合:仅上传模型参数(而非原始数据)到中央服务器进行聚合。

- 全局更新:服务器将聚合后的模型分发给各参与方,实现知识共享。

这种方式既保护了数据隐私,又能利用多方数据提升模型性能。

联邦学习的典型应用场景

医疗健康

在医疗领域,不同医院或研究机构的数据往往因隐私法规(如GDPR、HIPAA)无法共享,联邦学习可以:

- 跨机构疾病预测:多家医院协作训练AI模型,提高癌症、糖尿病等疾病的诊断准确率,而无需共享患者数据。

- 药物研发:制药公司可以联合多家医疗机构分析药物效果,加速新药开发。

金融风控

银行和金融机构需要评估用户信用风险,但客户数据涉及高度敏感信息,联邦学习可以:

- 联合反欺诈:多家银行共同训练反欺诈模型,提高识别能力,同时避免数据泄露。

- 信用评分优化:在不交换用户交易记录的情况下,提升信用评分的准确性。

智能终端(如手机输入法)

谷歌的Gboard输入法就是联邦学习的典型应用:

- 个性化推荐:手机在本地学习用户的输入习惯,仅上传模型更新,而非用户输入的具体内容。

- 隐私保护:用户数据始终保留在设备上,避免被滥用。

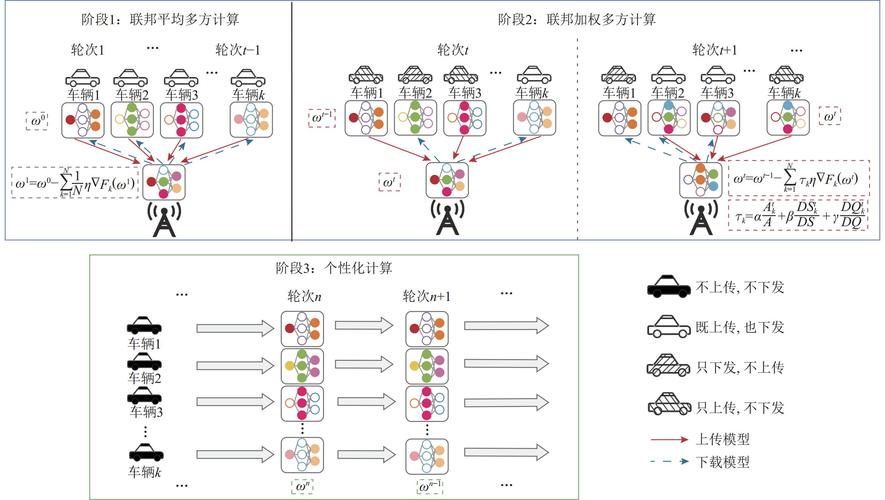

智慧城市与物联网(IoT)

在智慧交通、智能家居等场景中,联邦学习可以:

- 交通流量预测:多个城市的交通管理部门协作优化交通信号灯控制,而无需共享具体车辆数据。

- 智能家居优化:不同家庭的智能设备(如温控器、摄像头)可以共同学习用户习惯,提升服务体验,同时保护家庭隐私。

联邦学习面临的挑战

尽管联邦学习在隐私保护方面具有巨大优势,但在实际应用中仍面临诸多挑战:

数据异构性(Non-IID数据)

在传统机器学习中,数据通常独立同分布(IID),但联邦学习中的数据往往是非独立同分布的(Non-IID)。

- 不同医院的病人数据分布可能差异很大(某些医院癌症患者较多,另一些医院心脏病患者较多)。

- 这可能导致模型在部分参与方上表现不佳,影响整体效果。

解决方案:

- 采用个性化联邦学习,允许不同参与方保留部分本地特征。

- 使用迁移学习或元学习(Meta-Learning)提升模型泛化能力。

通信开销

联邦学习需要频繁上传和下载模型参数,如果参与设备数量庞大(如数百万台手机),可能导致:

- 网络带宽压力大:特别是模型较大时(如深度学习模型)。

- 训练速度慢:设备间通信延迟可能拖慢整体训练效率。

解决方案:

- 采用模型压缩技术(如量化、剪枝)减少参数大小。

- 设计更高效的聚合算法,减少通信轮数。

隐私泄露风险

虽然联邦学习不直接共享原始数据,但研究表明,恶意攻击者仍可能通过模型参数反推敏感信息(如成员推理攻击、模型逆向攻击)。

解决方案:

- 结合差分隐私(Differential Privacy, DP),在模型参数中添加噪声,降低可追溯性。

- 使用安全多方计算(Secure Multi-Party Computation, SMPC)或同态加密(Homomorphic Encryption, HE)增强安全性。

参与方激励机制

在跨机构协作中,如何激励各方积极参与是一个关键问题。

- 某些医院可能担心贡献数据却无法获得足够回报。

- 恶意参与方可能上传低质量数据或虚假模型更新(投毒攻击)。

解决方案:

- 设计合理的贡献评估机制(如Shapley值)公平分配收益。

- 采用区块链技术记录参与方的贡献,确保透明性和可信度。

未来展望

联邦学习作为隐私保护AI的重要技术,正在医疗、金融、物联网等领域展现巨大潜力,未来可能的发展方向包括:

- 联邦学习与边缘计算结合:在终端设备(如手机、传感器)上实现更高效的本地训练。

- 跨模态联邦学习:融合文本、图像、语音等多种数据,提升模型能力。

- 标准化与法规支持:随着各国数据保护法规的完善,联邦学习可能成为合规AI的重要解决方案。

联邦学习为数据隐私与AI发展的矛盾提供了可行的解决方案,但其落地仍面临数据异构、通信效率、安全风险等挑战,随着算法优化和硬件进步,联邦学习有望在更多场景中发挥关键作用,推动AI向更安全、更合规的方向发展。

如果你对联邦学习感兴趣,欢迎在评论区交流讨论!🚀

本文由Renrenwang于2025-04-03发表在人人写论文网,如有疑问,请联系我们。

本文链接:http://www.renrenxie.com/byslw/98.html