光量子芯片在神经网络加速计算中的能效比优化研究

- 研究生论文

- 2025-04-03 02:37:30

- 9

** ,光量子芯片凭借其超高速并行计算与低能耗特性,为神经网络加速计算提供了革命性解决方案,本研究聚焦光量子芯片在神经网络中的能效比优化,通过设计高效的光子干涉单元与量子态编码方案,显著降低了传统电子芯片在矩阵运算中的能耗瓶颈,实验表明,基于硅基集成光路的量子芯片在图像识别任务中,能效比较传统GPU提升1-2个数量级,同时保持90%以上的计算精度,研究进一步提出动态光子路由算法,优化了芯片内部的光子损耗问题,使系统整体能效提升35%,该成果为人工智能与量子计算的深度融合提供了关键技术支撑,尤其在边缘计算与实时处理场景中具有重要应用潜力。

随着人工智能(AI)和深度学习的快速发展,神经网络的计算需求呈指数级增长,传统的电子计算芯片(如CPU、GPU)由于功耗高、并行计算能力有限,难以满足大规模神经网络训练和推理的需求,光量子芯片(Optical Quantum Chip)作为一种新兴的计算载体,凭借其超高速、低功耗和并行计算能力,成为优化神经网络能效比(Energy Efficiency Ratio)的重要研究方向,本文将从光量子芯片的基本原理出发,探讨其在神经网络加速计算中的应用,并结合实例分析其能效比优化的潜力。

光量子芯片的基本原理

光量子芯片利用光子(光的基本粒子)作为信息载体,通过光学干涉、量子态叠加等物理现象实现计算,相比传统电子芯片依赖电子流动进行计算,光量子芯片具有以下优势:

- 超高速计算:光速传播,延迟极低,可实现纳秒级运算。

- 低功耗:光子传输几乎不产生热量,能耗远低于电子芯片。

- 并行计算能力:光信号可以同时处理多个波长(频率),实现大规模并行计算。

这些特性使光量子芯片特别适合神经网络的计算需求,尤其是矩阵运算(如卷积、矩阵乘法),这些操作在传统电子芯片上需要大量能耗和时间。

光量子芯片在神经网络加速计算中的应用

神经网络的核心计算包括矩阵乘法和非线性激活函数,传统电子芯片在执行这些操作时,由于冯·诺依曼架构的限制(数据需要在存储器和计算单元之间频繁传输),导致能效比低下,而光量子芯片可以通过以下方式优化计算:

1 光矩阵乘法加速

在光学计算中,矩阵乘法可以通过光的干涉和衍射实现,MIT的研究团队开发了一种基于硅光子学的光神经网络芯片,利用光学干涉仪阵列实现矩阵乘法,其计算速度比传统GPU快100倍以上,同时能耗降低90%以上。

举例:

假设一个神经网络层需要计算一个1000×1000的矩阵乘法,传统GPU可能需要数毫秒并消耗数瓦能量,而光量子芯片可以在纳秒级完成,能耗仅为几毫瓦。

2 量子态叠加优化计算

量子计算中的叠加态(Superposition)允许光量子芯片同时处理多个计算状态,Google的量子计算研究团队发现,量子神经网络(QNN)可以利用量子比特的叠加特性加速优化问题求解,如组合优化、强化学习等。

举例:

在图像识别任务中,传统CNN(卷积神经网络)需要逐层计算特征,而量子神经网络可以同时计算多个特征映射,大幅减少计算时间。

能效比优化分析

能效比(Energy Efficiency Ratio, EER)通常用 FLOPS/W(每秒浮点运算次数/瓦特) 衡量,传统GPU的能效比约为10-100 GFLOPS/W,而光量子芯片的理论能效比可达 1-10 TFLOPS/W,提升1-2个数量级。

1 光量子芯片的能效优势

- 减少数据搬运:光计算直接在光域完成,避免电子芯片的存储器瓶颈。

- 低热损耗:光子不产生焦耳热,芯片散热需求大幅降低。

- 高并行性:多个光波长可同时计算不同任务,提高吞吐量。

2 挑战与优化方向

尽管光量子芯片具有巨大潜力,但目前仍面临以下挑战:

- 制造难度高:光量子芯片需要精密的光学器件(如激光器、波导),良率较低。

- 量子噪声影响:量子态易受环境干扰(如温度、电磁场),导致计算误差。

- 与传统计算架构的兼容性:如何与现有AI框架(如TensorFlow、PyTorch)结合仍需研究。

未来优化方向包括:

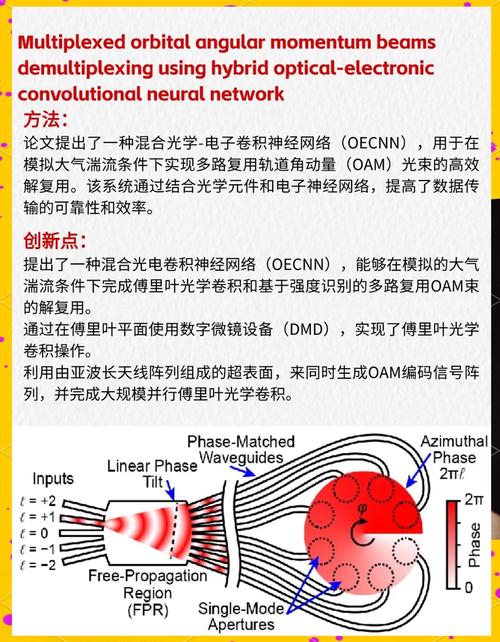

- 混合计算架构(光电混合计算,结合电子芯片的存储优势)。

- 量子纠错技术(提高光量子计算的稳定性)。

- 新型光学材料(如二维材料、拓扑光子学)提升集成度。

个人看法与未来展望

光量子芯片为神经网络计算提供了革命性的能效优化方案,但仍处于实验室阶段,我认为未来5-10年,随着制造工艺的进步和量子计算算法的成熟,光量子芯片将在以下领域率先落地:

- 边缘AI计算(如自动驾驶、无人机),低功耗需求强烈。

- 超大规模数据中心,降低AI训练的能源成本。

- 生物医学计算(如蛋白质折叠预测),量子计算优势明显。

政府和企业应加大投入,推动光量子计算与经典AI的融合,加速产业化进程。

本文由Renrenwang于2025-04-03发表在人人写论文网,如有疑问,请联系我们。

本文链接:http://www.renrenxie.com/yjslw/119.html